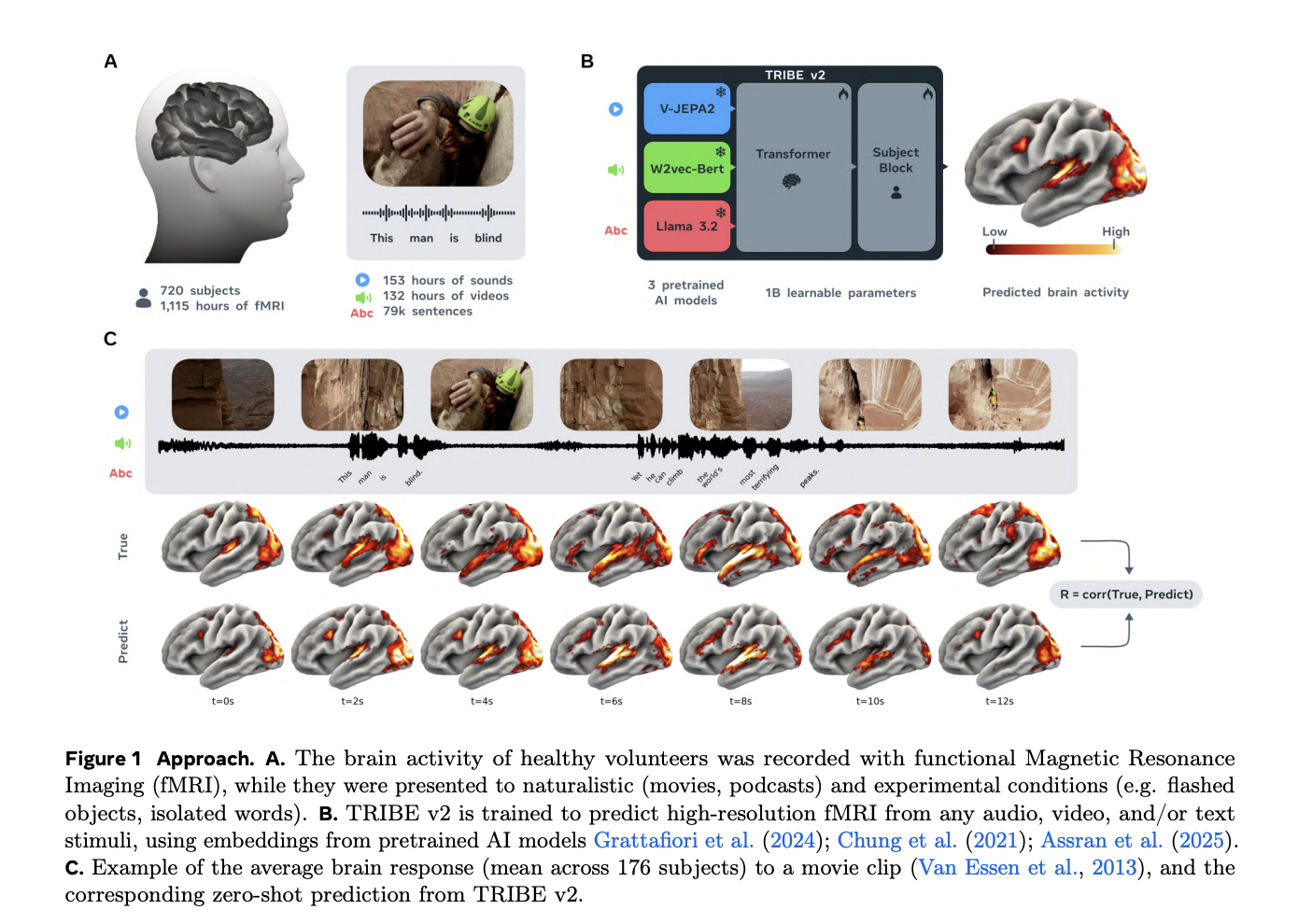

Meta выпустила модель TRIBE v2, которая предсказывает активность мозга при восприятии видео, аудио и текста. По информации компании, модель использует данные функциональной магнитно-резонансной томографии (fMRI) для анализа реакций мозга на различные типы стимулов.

Традиционный подход в нейронауке предполагает изучение отдельных когнитивных функций в изолированных областях мозга. Исследователи обычно связывают движение с областью V5 или распознавание лиц с веретенообразной извилиной, используя модели, разработанные для узких экспериментальных парадигм. Такой метод обеспечил глубокое понимание отдельных процессов, но привел к фрагментированному знанию без единой системы объяснения.

Модель TRIBE v2 предназначена для преодоления этого разрыва. Система анализирует мультимодальные данные — видео, аудиоряд и текст — в единой архитектуре. По данным Meta, это позволяет создать более полную картину того, как мозг обрабатывает информацию из разных источников.

Компания подчеркивает, что модель основана на предыдущей версии TRIBE и представляет развитие в области нейроинформатики. Исследователи продолжают использовать полученные данные для лучшего понимания когнитивных процессов.

Аналитики отмечают, что такие разработки могут иметь применение в изучении нейродегенеративных заболеваний и оптимизации интерфейсов человек-компьютер. Однако модель остается инструментом для научных исследований и требует дальнейшей валидации на независимых выборках.

Источник: Marktechpost